隨著人工智能技術以前所未有的速度融入社會生產與生活的各個角落,其潛在的倫理風險與治理挑戰日益凸顯。如何確保這項強大的技術“不作惡”,真正造福人類社會,已成為全球科技界、學術界和政策制定者共同關注的核心議題。作為全球領先的技術企業,微軟不僅率先提出了一套系統性的AI道德準則,更致力于將其深度融入人工智能基礎軟件的開發流程之中,為行業的健康發展提供了重要參考。

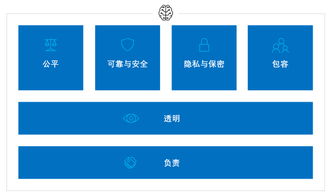

微軟提出的AI道德準則主要包括以下六個核心維度,它們共同構成了一個負責任AI開發的框架:

- 公平性:確保AI系統對所有用戶一視同仁,不會因種族、性別、年齡或其他特征而產生歧視性結果。這要求在數據收集、算法設計和模型評估的全過程中,主動識別并消除偏見。在軟件開發層面,微軟提供了如Fairlearn等開源工具包,幫助開發者檢測和緩解模型中的不公平現象。

- 可靠性與安全性:AI系統必須是健壯、可靠且安全的。這意味著它們應在預期的操作條件下以及面對惡意攻擊或意外輸入時,都能保持性能穩定,不會造成物理或數字傷害。基礎軟件的開發需要將安全性設計置于首位,進行嚴格的測試與驗證。

- 隱私與安全保障:在數據驅動的AI時代,保護個人隱私和數據安全至關重要。AI系統的開發必須遵循數據最小化、加密、匿名化等原則,確保用戶信息得到妥善保護,并賦予用戶對其數據的控制權。

- 包容性:AI技術應賦能和惠及地球上的每一個人,包括殘障人士或處于技術邊緣的群體。這就要求開發過程充分考慮多樣化的用戶需求和使用場景,確保產品和服務易于訪問和使用。

- 透明性:AI系統不應是“黑箱”。透明性原則要求系統的運作機制、能力、局限性以及決策依據盡可能清晰可解釋。這不僅有助于建立用戶信任,也便于審計和問責。微軟倡導“可解釋的AI”,并在其云平臺中集成了模型解釋功能。

- 問責制:明確人類在AI系統生命周期中的責任至關重要。開發者和部署組織必須為AI系統的行為及其社會影響負責。這需要建立清晰的治理結構、審計流程和補救機制。

將道德準則融入基礎軟件開發

提出準則僅是第一步,將其切實嵌入到AI基礎軟件(如機器學習框架、云AI服務、開發工具鏈)的開發實踐中,才是確保“不作惡”的關鍵。微軟通過以下方式實現這一目標:

- 設計層面融入:在軟件架構和產品設計的初始階段,就將六大準則作為必須考量的非功能性需求。例如,在設計Azure認知服務時,會預先評估其面部識別技術可能帶來的公平性風險,并據此設定使用限制和改進方向。

- 工具與流程支持:開發并提供一系列內部及開源的工具、檢查清單和評估框架,幫助開發團隊在編碼、測試和部署的各個環節自查是否符合道德準則。例如,使用“負責任AI影響評估”清單來系統化地審視項目。

- 文化與教育:在公司內部培養深厚的負責任AI文化,對全體員工,尤其是工程師和產品經理,進行持續的倫理培訓,使其具備識別和應對倫理問題的能力。

- 跨學科協作:建立包括工程師、倫理學家、法律專家、社會科學家在內的多元化團隊,共同審查高風險的AI項目,確保技術方案兼顧多方視角。

- 持續監控與改進:認識到AI系統的倫理影響是一個動態過程,因此建立上線后的持續監控機制,根據實際反饋和數據不斷優化模型與系統,迭代改進其公平性、可靠性等表現。

挑戰與未來展望

盡管微軟的實踐提供了有價值的范例,但確保AI“不作惡”依然任重道遠。不同文化背景下的倫理標準存在差異,技術的高速發展不斷帶來新的倫理困境,而平衡創新與監管也需要持續的探索。

人工智能基礎軟件的開發必將更加緊密地與倫理準則相結合。這需要整個生態系統的共同努力——技術公司持續投入工具研發與實踐,學術界深化倫理研究,政策制定者推動建立靈活而有效的治理框架,公眾則積極參與監督與討論。唯有通過這種協同共治,我們才能最大限度地引導人工智能向著透明、負責、普惠的方向發展,確保這項革命性技術真正成為推動社會進步的善的力量。